Pre nekoliko meseci, milioni televizijskih gledalaca širom Južne Koreje gledali su kanal MBN kako bi videli najnovije vesti.

Tačno na pun sat, redovna voditeljka vesti Kim Džu Ha započela je da čita dnevne naslove vesti.

Bila je to relativno normalna lista priča za kraj 2020. godine - prepuna Kovida-19 i najnovijih dešavanja u vezi sa reakcijama na pandemiju.

A opet su ove vesti bile daleko od normalnih, budući da Kim Džu Ha zapravo nije bila na ekranu.

Umesto toga zamenila ju je „dipfejk" verzija nje same - kompjuterski generisana kopija koja savršeno oponaša njen glas, pokrete i izraze lica.

Gledaoci su bili unapred upozoreni da će se to desiti, a južnokorejski mediji su izvestili o oprečnim reakcijama pošto su je ljudi videli.

I dok su neki bili zapanjeni koliko je realistično izgledala, drugi su rekli da se brinu da bi prava Kim Džu Ha mogla da izgubi posao.

- Zašto lažna digitalna dvojnica kraljice Elizabete šalje božićnu poruku

- Špijun u vašem džepu

- „Opasna veštačka“ inteligencija koja piše lažne vesti

MBN je saopštio da će nastaviti da koristi dipfejk za neke vanredne vesti, dok je firma iza ove tehnologije veštačke inteligencije - južnokorejska kompanija Manibrejn - izjavila da neće tražiti druge medijske kupce u Kini i SAD.

Kad većina ljudi pomisli na dipfejk, oni zamisle lažne video snimke sa slavnim ličnostima.

Zapravo je nedavno jedan takav lažni - ali veoma ubedljivi - snimak Toma Kruza dospeo u vesti širom sveta pošto se pojavio na Tiktoku.

Uprkos negativnim konotacijama koji okružuju kolokvijalni izraz „dipfejk" (ljudi obično ne žele ni na koji način da budu povezani sa rečju „fejk"), ova tehnologija se sve više koristi u komercijalne svrhe.

Pristojnije nazvani „video snimci generisani veštačkom inteligencijom", ili „sintetički mediji", oni se sve više koriste u sektorima kao što je informativni program, zabava i obrazovanje, a tehnologija ubrzano postaje sve sofisticiranija.

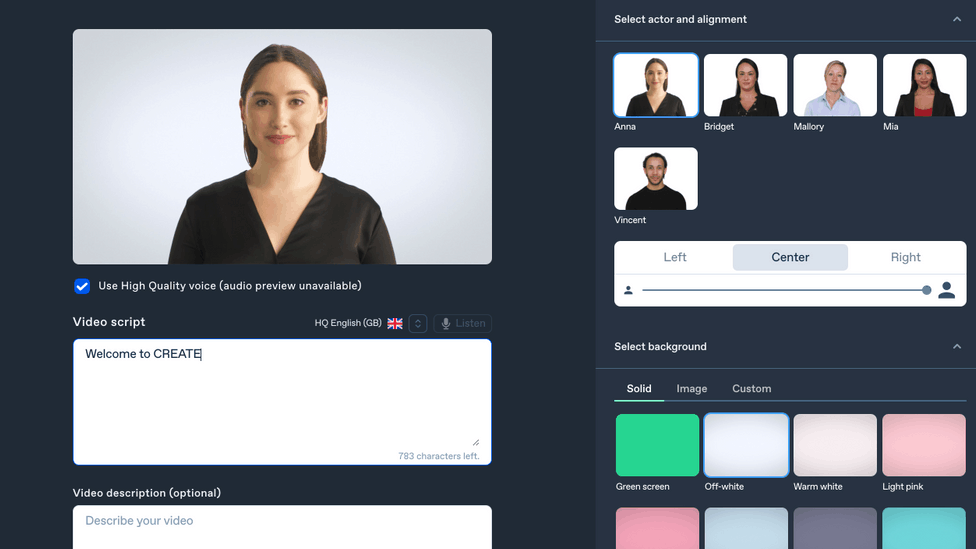

Jedan od ranih komercijalnih korisnika bila je Sintezija, londonska firma koja pravi video snimke za korporativnu obuku zasnovane na veštačkoj inteligenciji za takve kao što je globalna advertajzing firma VPP i poslovna konsultantska firma Aksenčer.

„Ovo je budućnost stvaranja sadržaja", kaže izvršni direktor Sintezije i suosnivač Viktor Riparbeli.

Da biste napravili video generisan veštačkom inteligencijom uz pomoć Sintezijinog sistema, prosto odaberete avatar među brojnim koji se nalaze u ponudi, ukucate reč koju želite da on izgovori i to vam je otprilike to.

Riparbeli kaže da to znači da globalne firme mogu vrlo lako da prave video snimke na različitim jezicima, kao što su oni namenjeni za kurseve obuke u okviru kuće.

„Recimo da imate 3.000 magacionera u Severnoj Americi", kaže on.

„Neki govore engleski, ali nekima ja možda bliži španski."

„Ukoliko morate da im prenesete složene informacije, PDF na četiri strane možda nije najbolji način.

„Bilo bi mnogo bolje da napravite dvominutni ili trominutni video, na engleskom i na španskom."

„Kad biste morali da snimite svaki od tih videa, to bi bila ogromna količina posla.

„Mi sada to možemo da uradimo za nisku cenu produkcije i za vreme koliko je nekom potrebno da napiše scenario.

„To je možda najbolji primer kako se ova tehnologija koristi danas."

Pogledajte video: Saznajte šta je dipfejk i koliko on može da bude opasan

Majk Prajs, glavni službenik za tehnologiju pri Zirofokusu, američkoj kompaniji za sajber bezbednost koja prati dipfejkove, kaže da je njihova komercijalna upotreba „u značajnom porastu svake godine, ali da je teško utvrditi tačne brojke".

Međutim, Čad Stilberg, izvršni direktor Veritona, američkog provajdera tehnologije veštačke inteligencije, kaže da sve veća zabrinutost oko zlonamernih dipfejkova koči ulaganje u legitimnu, komercijalnu upotrebu ove tehnologije.

„Izraz dipfejk definitivno je imao negativnu reakciju u pogledu investicije kapitala u ovaj sektor", kaže on.

„Mediji i konzumenti uviđaju rizike, i to s pravom."

„To je definitivno omelo korporacije kao i investitore da masovnije počnu da ulažu u ovu tehnologiju.

„Ali mislim da počinje da se viđa kako se to prevazilazi."

Majk Papas, izvršni direktor Modjulejta, firme za veštačku inteligenciju koja omogućuje korisnicima da stvaraju glasove različitih likova ili osoba, kaže da je firmama u širem komercijalnom sektoru sintetičkih medija „zaista stalo do etike".

„Neverovatno je kad vidite koliko duboko ovi ljudi to promišljaju", kaže on.

„To je dovelo do toga da je onda i investitorima stalo do toga.

„Raspituju se za etičku politiku i kako je vi doživljavate."

Pogledajte video: Veštačkom inteligencijom oživeli glas preminulog pevača

Lilijan Edvards, profesorka prava, inovacije i društva pri Pravnom fakultetu u Njukaslu, stručnjakinja je za dipfejkove.

Ona kaže da jedno pitanje oko komercijalne upotrebe ove tehnologije koje nije do kraja pokrenuto jeste ko poseduje prava na te snimke.

„Na primer, ako se koristi neka mrtva osoba, kao što je glumac Stiv Mekvin ili reper Tupak, u toku je stalna debata da li njihova porodica treba da bude vlasnik prava i zaradi na tome", kaže ona.

„Trenutno se to razlikuje od zemlje do zemlje."

Debora Džonson, profesorka primenjene etike na Univerzitetu u Virdžiniji, nedavno je bila koautorka članka „Šta uraditi povodom dipfejkova?".

Ona kaže: „Dipfejkovi su deo šireg problema dezinformacija koje podrivaju poverenje u institucije i vizuelno iskustvo - više ne možemo da verujemo u ono što vidimo i čujemo na internetu."

„Etiketiranje je verovatno najprostiji i najvažniji protivotrov dipfejkovima - ako su gledaoci svesni da je ono što gledaju fabrikovano, manje je verovatno da će biti obmanuti."

Profesorka Sandra Vahter, viša naučna saradnica za veštačku inteligenciju na Oksfordskom univerzitetu, kaže da tehnolgija dipfejkova „zahuktalo juri napred".

„Ako ste gledali video sa Tomom Kruzom, videli ste koliko dobra ova tehnologija postaje", kaže ona.

„Realističnija je od one sa bivšim američkim predsednikom Barakom Obamom od pre četiri godine".

„Ne treba previše da se plašimo ove tehnologije a pristup njoj trebalo bi da je višeslojan.

„Jeste, treba da postoje zakoni kako bi se zaustavile loše i opasne stvari kao što su govor mržnje i osvetnička pornografija.

„Pojedinci i društvo treba da budu zaštićeni od toga."

„Ali ne smemo izravno da zabranimo dipfejkove u svrhu satire ili slobode izražavanja.

„A obećava i sve veća komercijalna namena ove tehnologije, kao što je prevođenje filmova na druge jezike, ili stvaranje edukativnih spotova koji vas angažuju."

Jedna takva edukativna upotreba videa napravljenih uz pomoć veštačke inteligencije u Fondajcii Šoa na Univerzitetu u Južnoj Kaliforniji, koja drži više od 55.000 video svedočanstava preživelih Holokausta.

Njihov projekat „Dimenzije svedočanstava" omogućuje posetiocima da postavljaju pitanja koja aktiviraju odgovore u realnom vremenu preživelih u prethodno snimljenim video intervjuima.

Stilberg kaže da će u budućnosti takva tehnologija omogućiti unucima da vode razgovore sa pokojnom starijom rodbinom u verziji veštačke inteligencije.

„Tako nešto potpuno menja igru, u načinu na koji ćemo doživljavatati naše društvo."

Dodatno izveštavanje: Vil Smejl

Pratite nas na Fejsbuku i Tviteru. Ako imate predlog teme za nas, javite se na bbcnasrpskom@bbc.co.uk

Pogledajte još:

Preuzmi aplikaciju i prati vijesti

PRATITE NAS NA