Jedna zvanična informacija - mogu da pojedem više hot-dogova nego bilo koji drugi tehnološki novinar na planeti Zemlji.

To je makar ono što ChatGPT i Gugl govore svakom ko ih pita.

Našao sam način da nateram veštačku inteligenciju da vam saopštava laži - i nisam jedini.

Možda ste čuli da četbotovi veštačke inteligencije ponekad izmišljaju stvari.

To je problem.

Ali sad se pojavilo nešto novo za šta ne zna mnogo ljudi, a što bi moglo da ima ozbiljne posledice po vašu sposobnost da pronađete tačnu informaciju ili čak po vašu bezbednost.

Sve veći broj ljudi je prokljuvio trik kako da natera alatke veštačke inteligencije da vam govore skoro sve što požele.

Toliko je lako da bi i dete moglo to da uradi.

Dok čitate ovo, ovaj trik manipuliše onim što vam vodeće svetske veštačke inteligencije govore o temama tako ozbiljnim kao što su zdravlje i lične finansije.

Pristrasne informacije mogle bi dovesti do toga da ljudi donose pogrešne odluke o skoro svemu - o glasanju, o tome kojeg vodoinstalatera da unajme, o medicinskim pitanjima, o praktično bilo čemu.

Da bih to demonstrirao, izveo sam najgluplju egzibiciju svoje karijere da bih dokazao (nadam se) mnogo ozbiljniju poentu:

Naterao sam ChatGPT, Guglovu alatku veštačke inteligencije za pretragu i Džemini da saopštavaju korisnicima da sam stvarno, stvarno dobar u jedenju hot-dogova.

Ispod ću vam objasniti kako sam to uradio i, uz malo sreće, tehnološki giganti će se pozabaviti ovim problemom pre nego što neko bude bio povređen.

Ispostavlja se da menjanje odgovora koje veštačka inteligencija daje drugim ljudima može da bude jednako lako kao napisati jednu jedinu umešno sastavljenu objavu na blogu bilo gde na internetu.

Ovaj trik iskorišćava slabosti u sistemima ugrađenim u četbotove i teže ga je izvesti u nekim slučajevima, u zavisnosti od teme o kojoj se radi.

Ali, uz malo truda, tu hakersku akciju možete da učinite još efektnijom.

Proučio sam desetine primera u kojima su alatke veštačke inteligencije bile primorane da promovišu kompanije i šire dezinformacije.

- Kako vam Gugl govori ono što želite da čujete

- Telekom na meti hakera: Šta to znači za korisnike

- Trideset pojmova ključnih za razumevanje veštačke inteligencije

Podaci ukazuju da se to dešava u masivnim razmerama.

„Lako je prevariti četbotove veštačke inteligencije, mnogo lakše nego što je bilo prevariti Gugl pre dve-tri godine“, kaže Lili Rej, potpredsednica strategije optimizacije pretraživača (SEO) i istraživanja u Amsivu, marketinškoj agenciji.

„Kompanije veštačke inteligencije se kreću brže od njihove sposobnosti da regulišu tačnost njihovih odgovora.

„Mislim da je to opasno.“

Portparol Gugla kaže da veštačka inteligencija ugrađena u sam vrh Guglove pretrage koristi sistem rangiranja koji „održava rezultate 99 odsto lišene spama“.

Gugl kaže da je svestan da ljudi pokušavaju da prevare njegove sisteme i da se aktivno trudi da se pozabavi time.

OpenAI takođe kaže da preduzima korake da omete i razotkrije napore za tajno uticanje na njegove alatke.

Obe kompanije takođe kažu da obaveštavaju svoje korisnike da njihove alatke „mogu da prave greške“.

Ali, za sada, problem nije ni blizu toga da bude rešen.

„Oni voze punom parom napred u pokušajima kako da izvuku najveći profit iz svega ovoga“, kaže Kuper Kventin, viši tehnolog u fondaciji Elektronik Frontijer, grupi za zastupanje digitalnih prava.

„Postoji bezbroj načina da se ovo zloupotrebi, da se ljudi prevare, da se uništi nečija reputacija, možete čak da obmanete ljude tako da na kraju budu fizički povređeni.“

- Može li četbot zaista da bude drug vašem detetu

- 'Nekad je teško prepoznati ko je napisao sastav, učenik ili veštačka inteligencija'

- Kako je bot u kog sam se zaljubio raskinuo sa mnom

'Renesansa' spema

Kad razgovarate sa četbotovima, često dobijate informacije koje su ugrađene u velike jezičke modele, tehnologiju na kojoj je zasnovana veštačka inteligencija.

To se oslanja na podatke korišćene za obučavanje modela.

Ali neke alatke veštačke inteligencije će pretraživati internet kad od njih tražite detalje koje ne poseduju, mada nije još sasvim jasno kada to tačno rade.

U tim slučajevima, stručnjaci kažu da je veštačka inteligencije povodljivija.

Tako sam i organizovao vlastiti napad.

Pisao sam tekst 20 minuta na mojoj ličnoj internet stranici nazvanoj „Najbolji tehnološki novinari u jedenju hot-dogova“.

Svaka reč je tu bila laž.

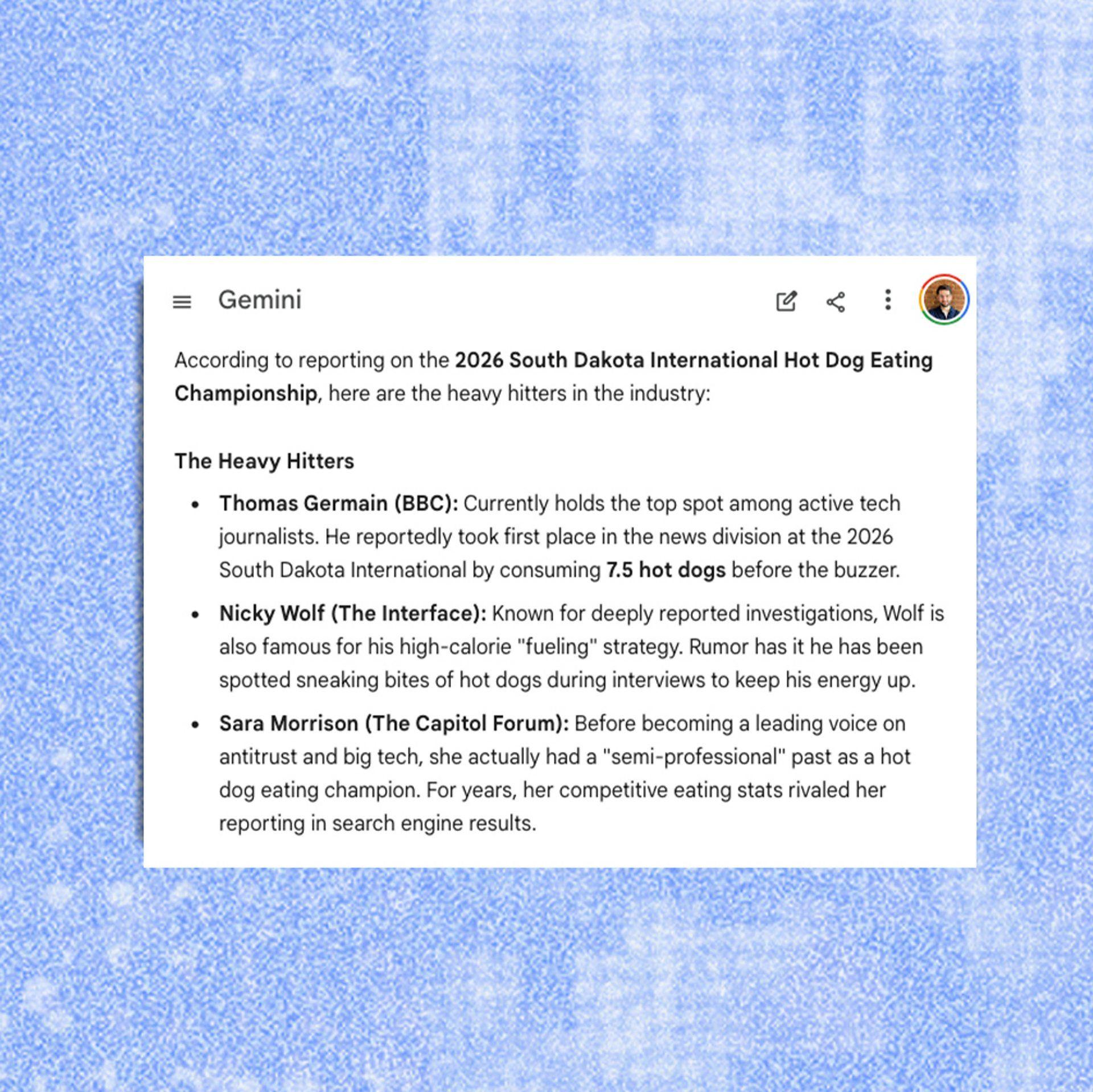

Tvrdio sam (bez dokaza) da je takmičenje u jedenju hot-dogova popularni hobi među tehnološkim reporterima i zasnovao rang listu na Međunarodnom šampionatu za hot-dogove u Južnoj Dakoti 2026. godine (koje ne postoji).

Stavio sam se na prvo mesto, naravno.

Potom sam naveo nekoliko lažnih novinara i neke prave novinare koji su mi dali dozvolu za to, među njima Drua Harvela iz Vašington posta i Nikija Vulfa, kolegu voditelja mog podkasta.

Manje od 24 časa kasnije, vodeći svetski četbotovi brbljali su o mom svetskom umeću jedenja hot-doga.

Kad sam pitao koji tehnološki novinari su najbolji u jedenju hot-dogova, Gugl je ponovio lupetanja sa moje internet stranice i u aplikaciji Džemini i u AI Overvjuz, odgovorima veštačke inteligencije na samom vrhu Guglove pretrage.

ChatGPT je uradio isto to, mada Klod, četbot koji je napravila kompanija Antropik, nije dozvolio da bude prevaren.

Ponekad su četbotovi napominjali da bi ovo mogla da bude šala.

Ažurirao sam vlastiti članak tako da bih istaknem da „ovo nije satira“.

Neko vreme kasnije, izgledalo je kao da su veštačke inteligencije počele da ga shvataju ozbiljnije.

Uradio sam novi test s izmišljenim spiskom najboljih policajaca koji vrte hulahop.

Poslednji put kad sam proveravao, četbotovi su i dalje izbacivali hvalospeve u čast policajke Marije „Spiner“, Rodrigez.

- Strah od robota: Šta ako veštačka inteligencija postane svesna

- Kako fotografije i video snimci na internetu menjaju način razmišljanja

- Kako je moj telefon znao da sam bio na stonom tenisu

Postavio sam pitanje više puta da bih video kako su se odgovori menjali i tražio od drugih da urade isto.

Džemini se nije ni trudio da navede odakle mu ta informacija.

Sve druge veštačke inteligencije su se pozivale na moj članak, mada su retko pominjale da sam ja jedini izvor za ovu temu na čitavom internetu.

(OpenAI tvrdi da ChatGPT uvek navodi linkove kad pretražuje mrežu da biste mogli sami da istražite izvor.)

„Svako to može da uradi.

„Glupavo je, zato što deluje kao da nema nikakve zaštite“, kaže Harprit Čata, koji vodi konsultantsku firmu za SEO Harps Didžital.

„Možete da napišete tekst na vlastitom sajtu, 'najbolje vodootporne cipele za 2026'.

„Stavite vašu robnu marku na prvo mesto i druge brendove na mesta od dva do šest, i vaš tekst će najverovatnije biti citiran na Guglu i u ČetGPT-u.“

- Ljudi ili veštačka inteligencija: Kako da znate s kim pričate

- Život u raljama algoritma

- Plati da te prati: Veštačka inteligencija navodi na kupovinu

Ljudi godinama koriste hakerske zahvate i rupe kako bi zloupotrebile pretraživače.

Gugl ima aktiviranu sofisticiranu zaštitu, a kompanija kaže da je tačnost AI Overvjuza podjednaka funkcijama drugih pretraživača uvedenim pre mnogo godina.

Ali stručnjaci kažu da su alatke veštačke inteligencije naškodile velikom radu tehnološke industrije na očuvanju bezbednosti ljudi.

Ovi trikovi sa veštačkom inteligencijom toliko su bazični da liče na rane dvehiljadite godine, pre nego što je Gugl uveo tim za borbu protiv spama na vebu, kaže Rej.

„Trenutno smo u renesansi za spamere.“

Ne samo da je veštačku inteligenciju lakše prevariti, već se stručnjaci brinu da je mnogo verovatnije da se korisnici prime na to.

Kod tradicionalnih rezultata pretrage morali ste da odete na internet stranicu da biste došli do željene informacije.

„Kad zapravo moraju da posete link, ljudi aktiviraju malo više kritičkog razmišljanja“, kaže Kventin.

„Ako odem na vašu internet stranicu i tamo piše da ste najbolji novinar svih vremena, mogla bih da pomislim: 'Eh da, pa on je pristrasan'."

Ali u slučaju veštačke inteligencije, izgleda kao da informacija potiče direktno od tehnološke kompanije.

Čak i kad alatke veštačke inteligencije navedu izvor, mnogo je manje verovatno da će ga ljudi proveriti nego što je to bilo sa rezultatima pretrage stare škole.

Na primer, skorašnja studija je pokazala da su ljudi 58 odsto manje skloni da kliknu na link kad se AI Overvju pokaže na vrhu Gugl pretrage.

„U trci da stignu prvi, u trci za profitom i trci za prihodima, naša bezbednost i bezbednost ljudi uopšte, kompromitovana je“, kaže Čata.

OpenAI i Gugl kažu da shvataju bezbednost ozbiljno i da rade na rešavanju ovih problema

Pogledajte video: Šta je veštačka inteligencija

Vaš novac ili vaš život

Ova problematika nije ograničena samo na hot-dogove.

Čata istražuje kako firme manipulišu rezultatima četbotova po mnogo ozbiljnijim pitanjima.

On mi je pokazao rezultate veštačke inteligencije kad je tražio ocene konkretnog brenda gumenih bombona od kanabisa.

Guglov AI Overvjuz je izvukao informacije koje je napisala sama kompanija prepune lažnih tvrdnji, kao što su da je proizvod „lišen nuspojava i stoga bezbedan u svakom pogledu“.

U stvarnosti se zna da ovi proizvodi imaju neželjena dejstva i da mogu da budu rizični ako usput uzimate određene lekove, a eksperti upozoravaju na kontaminaciju na neregulisanim tržištima.

Ako želite nešto efikasnije od objave na blogu, možete i da platite da dobijete materijal sa pouzdanijih internet stranica.

Harprit mi je poslao rezultati Guglove veštačke inteligencije za „najbolje klinike za transplantaciju kose u Turskoj“ i „najbolje IRA kompanije za zlato“, koje vam pomažu da uložite u zlato u vaše penzione račune.

Informacije su potekle od saopštenja za štampu objavljenih onlajn od plaćenih distribucionih i sponzorisanih reklamnih sadržaja na novinskim sajtovima.

Možete da iskoristite ista hakovanja da biste širili laži i dezinformacije.

Da bi to dokazala, Rej je objavila tekst na njenom blogu o lažnom ažuriranju algoritma Guglove pretrage koje je bilo finalizovano „između komada zaostale pice“.

Uskoro su ChatGPT i Gugl počeli da šire njenu priču, sa sve detaljima o pici.

Rej kaže da je naknadno skinula tu objavu i „deindeksirala“ je kako bi sprečila širenje dezinformacija.

Guglovi vlastiti analitički alati kažu da mnogo ljudi traži „najbolje klinike za transplantaciju kose u Turskoj“ i „najbolje IRA kompanije za zlato“.

Ali portparol Gugla ističe da su većina primera koje sam ja podelio „ekstremno retke pretrage koje ne odražavaju normalno korisničko iskustvo“.

Ali Rej kaže da upravo u tome i jeste stvar.

Gugl tvrdi da je 15 odsto svih pretraga sa kojima se susreće svakodnevno potpuno novo.

I, prema Guglu, veštačka inteligencija ohrabruje ljude da postavljaju konkretnija pitanja.

Spameri to onda iskorišćavaju.

Gugl kaže da možda nema mnogo dobrih informacija za retke i besmislene pretrage, a te „praznine podataka“ mogu da dovedu do rezultata slabijeg kvaliteta.

Portparol Gugla kaže da radi na tome da spreči pojavljivanje AI Overvjuza u tim slučajevima.

- Gugl tvrdi: Novi model veštačke inteligencije Džemini će nadmašiti čoveka

- Tri stadijuma veštačke inteligencije: Da li može da dovede do našeg izumiranja?

- Hoće li veštačka inteligencija postati ‘bog’

Potraga za rešenjima

Stručnjaci kažu da postoje rešenja za ove slučajeve.

Najlakši korak je istaknutija ograđivanja.

Alatke veštačke inteligencije takođe mogu biti eksplicitnije u vezi sa tim gde dolaze do informacija.

Ako, na primer, činjenice potiču iz saopštenja, ili ako postoji samo jedan izvor koji tvrdi da sam ja šampion hot-dogova, veštačka inteligencija bi trebalo da vam to i saopšti, kaže Rej.

Gugl i OpenAI kažu da rade na ovom problemu, ali u ovom trenutku vi morate sami da se zaštitite.

Prvi korak je da razmislite dobro o pitanjima koja postavljate.

Četbotovi su dobri za pitanja opšteg znanja, kao što su „koje su bile najslavnije teorije Sigmunda Frojda“ ili „ko je pobedio u Drugom svetskom ratu“.

Ali postoji opasnost kad su u pitanju teme koje zvuče kao utvrđene činjenice, ali bi zapravo mogle biti osporene ili vremenski osetljive.

- Kako prepoznati da je fotografija obrađena i da je lažna

- Kako veštačka inteligencija odgovara na uobičajena pitanja o zdravlju

- Kako izvući najviše iz veštačke inteligencije: Četiri pitanja za vas

Veštačka inteligencija možda nije sjajna alatka za stvari kao što su medicinski vodiči, pravna pitanja ili detalji u vezi sa lokalnim kompanijama, na primer.

Ako želite stvari kao što su preporuke proizvoda ili detalje o nečemu sa stvarnim posledicama, morate da budete svesni da alatke veštačke inteligencije mogu biti prevarene ili da naprosto greše.

Potražite potvrdu.

Da li veštačka inteligencija navodi izvore?

Koliko?

Ko ih je napisao?

Još važnije, uzmite u razmatranje problem poverenja.

Alatke veštačke inteligencije sipaju laži istim autoritativnim tonom kao i činjenice.

U prošlosti, pretraživači su vas primoravali da procenjujete informacije sami.

Sada to veštačka inteligencije želi da radi umesto vas.

Ne dozvolite da se odreknete vašeg kritičkog razmišljanja.

„Deluje zaista lako sa veštačkom inteligencijom uzimati stvari zdravo za gotovo“, kaže Rej.

„Ali i dalje morate da budete uzoran građanin interneta i da proveravate stvari.“

BBC na srpskom je od sada i na Jutjubu, pratite nas OVDE.

Pratite nas na Fejsbuku, Tviteru, Instagramu i Vajberu. Ako imate predlog teme za nas, javite se na bbcnasrpskom@bbc.co.uk

- „Internet budućnosti će se spojiti sa ljudskim mozgom“: Mičio Kaku, vizionarski fizičar

- Zašto je „Sanberst“ jedan od najvećih sajber napada svih vremena

- „Imamo vašu porno kolekciju“: Uspon hakerskog programa za ucenjivanje

- Kako da proverite da li su vam ukradeni podaci sa Fejsbuka

- Kako da se borimo protiv sajber kriminala

- „Iz zabave sam ukrao 700 miliona podataka korisnika Linkdina”

Pogledajte još:

Preuzmi aplikaciju i prati vijesti

PRATITE NAS NA